「1 线性回归」:打开人工智能的第一扇门

1.1 概念:模型简介与应用场景

1.2 原理:最小二乘法

1.3 优缺点分析

缺点:

1.4 代码实战

import numpy as np

import matplotlib.pyplot as plt

from sklearn.linear_model import LinearRegression

# 设置matplotlib支持中文显示

plt.rcParams['font.sans-serif'] = ['SimHei'] # 设置中文显示

plt.rcParams['axes.unicode_minus'] = False # 正确显示负号

# 创建武侠世界中的功力(X)与成名年数(y)的数据

X = np.array([1, 2, 3, 4, 5, 6, 7, 8, 9, 10]).reshape(-1, 1) # 功力等级

y = np.array([2, 3, 3.5, 5, 6, 7.5, 8, 9, 10.5, 11]) # 成名年数

# 使用线性回归模型

model = LinearRegression()

model.fit(X, y) # 训练模型

# 预测功力等级对应的成名年数

X_predict = np.array([11, 12, 13]).reshape(-1, 1) # 新的功力等级

y_predict = model.predict(X_predict) # 进行预测

# 绘制功力与成名年数的关系

plt.scatter(X, y, color='red', label='实际成名年数') # 原始数据点

plt.plot(X, model.predict(X), color='blue', label='功力成名模型') # 拟合的直线

plt.scatter(X_predict, y_predict, color='green', label='预测成名年数') # 预测点

plt.xlabel('功力等级')

plt.ylabel('成名年数')

plt.title('武侠世界的功力与成名年数关系')

plt.legend()

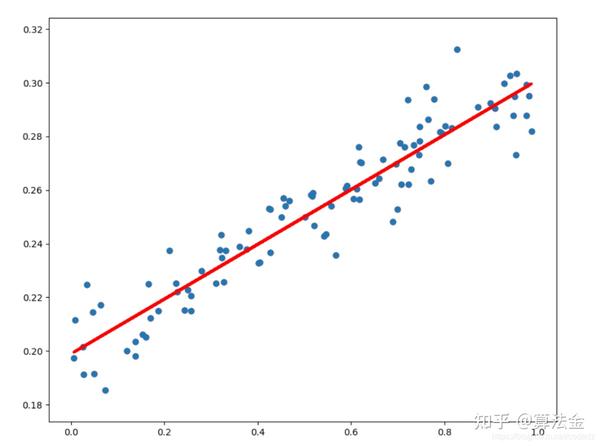

plt.show()线性回归作为人工智能领域的基石之一,不仅让我们了解到数据之间复杂关系的线性表达,还为我们提供了解决实际问题的有效工具。

通过学习和应用线性回归,我们能够更深入地探索数据科学和机器学习的奥秘。

「 2 逻 辑 回 归 」:从线性到分类的桥梁

2.1 概念:与线性回归的联系与区别

联系与区别:

2.2 原理: 函数

2.3 应用场景:二分类问题

2.4 优缺点分析

缺点:

from sklearn.linear_model import LogisticRegression

from sklearn.datasets import make_classification

import matplotlib.pyplot as plt

import numpy as np

# 生成模拟的武侠世界功力和内功心法数据集

X, y = make_classification(n_samples=100, n_features=2, n_informative=2, n_redundant=0, n_clusters_per_class=1, random_state=42)

# 创建逻辑回归模型对象

lr = LogisticRegression()

# 训练模型

lr.fit(X, y)

# 定义决策边界绘制函数

def plot_decision_boundary(X, y, model):

# 设置最小和最大值,以及增量

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1

y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.1),

np.arange(y_min, y_max, 0.1))

# 预测整个网格的值

Z = model.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

# 绘制决策边界和散点图

plt.contourf(xx, yy, Z, alpha=0.4)

plt.scatter(X[:, 0], X[:, 1], c=y, s=20, edgecolor='k')

plt.xlabel('功力')

plt.ylabel('内功心法')

plt.title('武侠世界中的高手分类图')

# 绘制决策边界和数据点

plot_decision_boundary(X, y, lr)

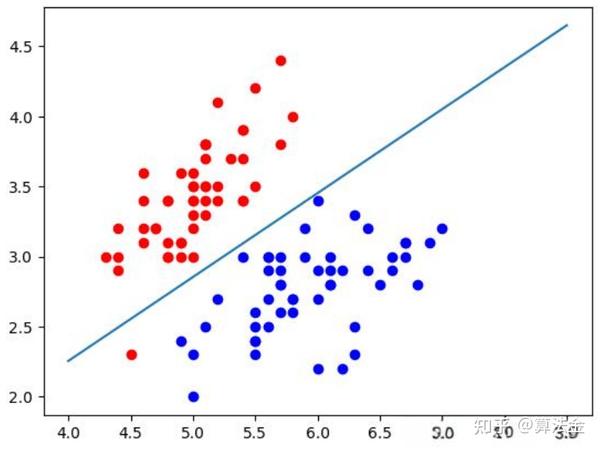

plt.show()我们首先使用函数生成了一组模拟的二维数据,模拟武侠世界中的人物根据其功力和内功心法被分为两类:普通武者和高手。

然后,我们训练了一个逻辑回归模型并绘制了决策边界,以及不同类别的样本点,直观展示了模型的分类效果。

在图形中,我们可以看到如何根据功力和内功心法来区分不同的武侠人物。

逻辑回归作为分类问题中的重要工具,其简单、高效的特性使它成为了许多领域的首选算法。

了解和掌握逻辑回归,对于进一步学习更复杂的分类算法打下了坚实的基础。

「 3 决策树」:模拟决策过程的直观方法

3.1 概念:直观的决策模拟过程

特点:

3.2 核心原理:信息增益 & 基尼系数

基尼系数:

3.3 应用场景

3.4 优缺点分析

缺点:

from sklearn.datasets import make_classification

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier

import matplotlib.pyplot as plt

import numpy as np

# 生成武侠风格的数据,确保所有特征值为正数

X, y = make_classification(n_samples=200, n_features=2, n_redundant=0, n_informative=2,

n_clusters_per_class=1, random_state=42)

X += np.abs(X.min()) # 平移数据确保为正

# 将数据集分为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 创建决策树模型,并设置最大深度为3

dt = DecisionTreeClassifier(max_depth=3)

# 训练模型

dt.fit(X_train, y_train)

# 绘制数据点和决策边界

def plot_decision_boundary(model, X, y):

# 设置最小和最大值,以及增量

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1

y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.01),

np.arange(y_min, y_max, 0.01))

# 预测整个网格的值

Z = model.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

# 绘制决策边界

plt.contourf(xx, yy, Z, alpha=0.4)

# 绘制不同类别的样本点

plt.scatter(X[y == 0][:, 0], X[y == 0][:, 1], c='red', marker='x', label='普通武者')

plt.scatter(X[y == 1][:, 0], X[y == 1][:, 1], c='blue', marker='o', label='武林高手')

plt.xlabel('功力值')

plt.ylabel('内功心法')

plt.title('武侠世界中的武者分类图')

plt.legend()

# 绘制决策边界和数据点

plot_decision_boundary(dt, X, y)

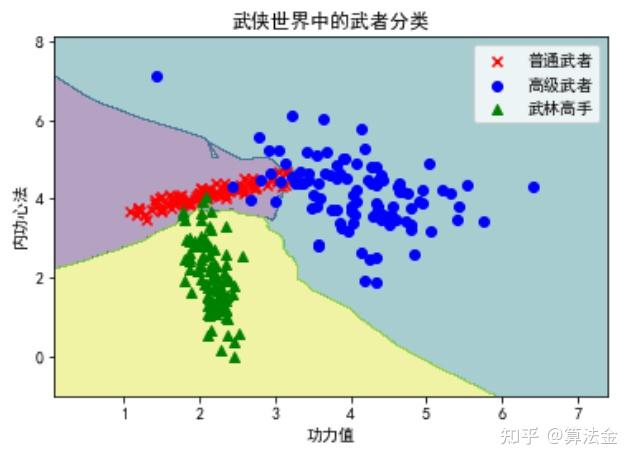

plt.show()这段代码首先生成了一组包含200个样本的武侠风格数据,每个样本有两个特征:功力值和内功心法,目标是分类武者是否为武林高手。

然后,我们使用er创建了一个决策树模型并对其进行训练。

通过定义ry函数,我们绘制了模型的决策边界,并使用不同颜色和形状标记来区分普通武者和武林高手,直观地展示了决策树在二分类任务中的分类效果。

【你可以修改 看看有什么变化】

决策树通过简单的决策规则来对数据进行分类或回归预测,它的直观性和简单性使得它成为机器学习入门者必学的算法之一。

尽管存在过拟合等问题,但通过适当的剪枝策略和集成学习方法,决策树仍然是一个非常强大和实用的工具。

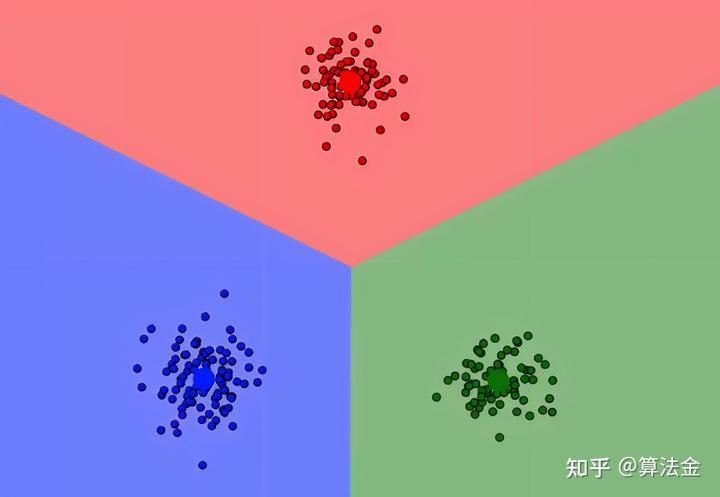

「 4 K近邻算法 (K-NN)」:简单直观的分类与回归方法

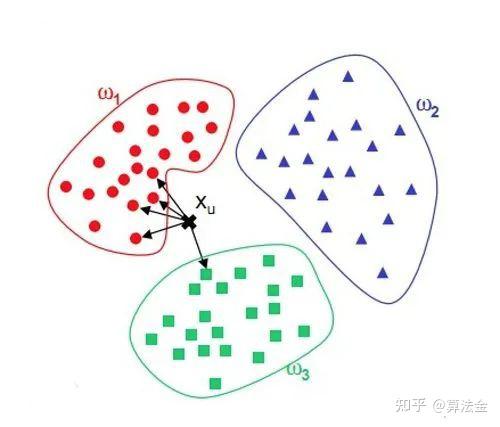

4.1 概念:简单直观的分类算法

4.2 原理:距离度量

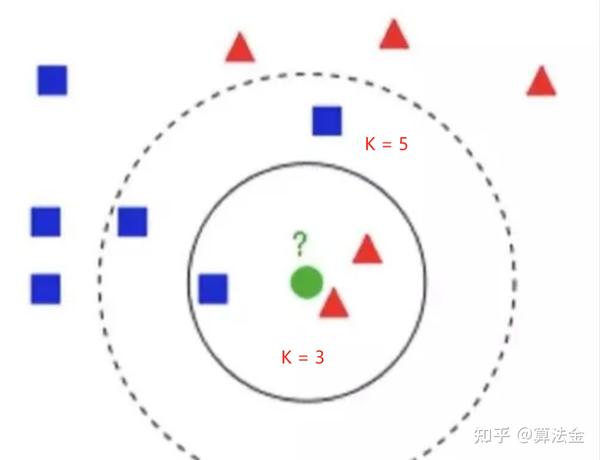

4.3 选择 K 值的策略

误差分析:观察不同K值下的误差率,选择误差最小化的K值。

4.4 应用场景

4.5 优缺点分析

缺点:

from sklearn.datasets import make_classification

from sklearn.neighbors import KNeighborsClassifier

from sklearn.model_selection import train_test_split

import matplotlib.pyplot as plt

import numpy as np

# 生成武侠风格的数据:功力值和内功心法作为特征,三个类别的武者

X, y = make_classification(n_samples=300, n_features=2, n_informative=2, n_redundant=0,

n_clusters_per_class=1, n_classes=3, random_state=42)

X += np.abs(X.min()) # 确保所有特征值为正

# 将数据集分为训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3, random_state=42)

# 创建K近邻模型,设置邻居数为5

knn = KNeighborsClassifier(n_neighbors=5)

# 训练模型

knn.fit(X_train, y_train)

# 绘制数据点和分类结果

def plot_classification_results(model, X, y):

# 创建一个网格来绘制分类结果

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1

y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.01),

np.arange(y_min, y_max, 0.01))

# 预测网格中每个点的类别

Z = model.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

# 绘制分类结果

plt.contourf(xx, yy, Z, alpha=0.4)

# 绘制数据点

plt.scatter(X[y == 0][:, 0], X[y == 0][:, 1], c='red', marker='x', label='普通武者')

plt.scatter(X[y == 1][:, 0], X[y == 1][:, 1], c='blue', marker='o', label='高级武者')

plt.scatter(X[y == 2][:, 0], X[y == 2][:, 1], c='green', marker='^', label='武林高手')

plt.xlabel('功力值')

plt.ylabel('内功心法')

plt.title('武侠世界中的武者分类')

plt.legend()

# 绘制分类结果

plot_classification_results(knn, X, y)

plt.show()我们首先生成了一个具有300个样本和2个特征的数据集,这些特征分别代表武侠世界中武者的“功力值”和“内功心法”,且所有特征值都被调整为正值。

我们的目标是将这些武者分类为三个类别:“普通武者”、“高级武者”和“武林高手”,分别使用不同的颜色和形状标记来区分。

通过使用K近邻算法模型进行训练和分类,最后我们绘制了分类结果的可视化图,其中不同颜色的区域代表了模型预测的不同类别。

【你可以修改 (K值)看看有什么变化】

K近邻算法以其简单直观和易于实现的特性,在机器学习初学者中非常受欢迎。

尽管它在处理大型数据集时存在计算成本和内存使用的挑战,但通过适当的优化和应用场景选择,K-NN仍然是一个非常有用的工具。

「5 朴素贝叶斯」:基于概率的简洁分类算法

5.1 概念:基于概率的分类方法

特点:简单、高效,特别适用于维度高的数据集,如文本分类。

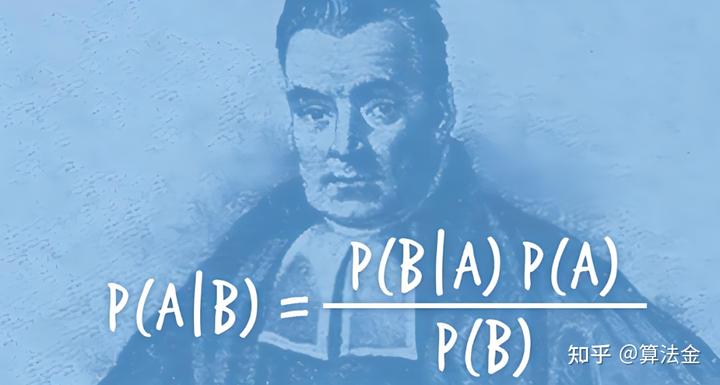

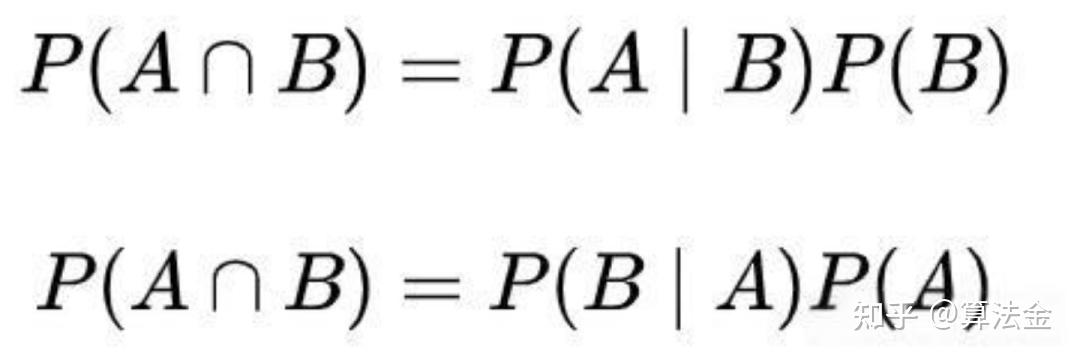

5.2 核心原理:贝叶斯定理

应用:

5.3 应用实例:垃圾邮件过滤

5.4 优缺点分析

缺点:

朴素贝叶斯算法以其简单性和高效性,在机器学习领域占有一席之地。

尽管其“朴素”的假设在现实应用中可能受到挑战,但通过合理的特征选择和适当的数据预处理,朴素贝叶斯依然能够在许多场景下发挥出色的性能。

顺便说一句,这是我们的第一个正式的公式,前面几个算法的数学式子我都给省了,这个贝叶斯公式不能省。

要理解和记忆它并不难,下图 2 的两个式子右边一组合,然后把其中一项挪过去当分母就是图 3 贝叶斯定理的式子了

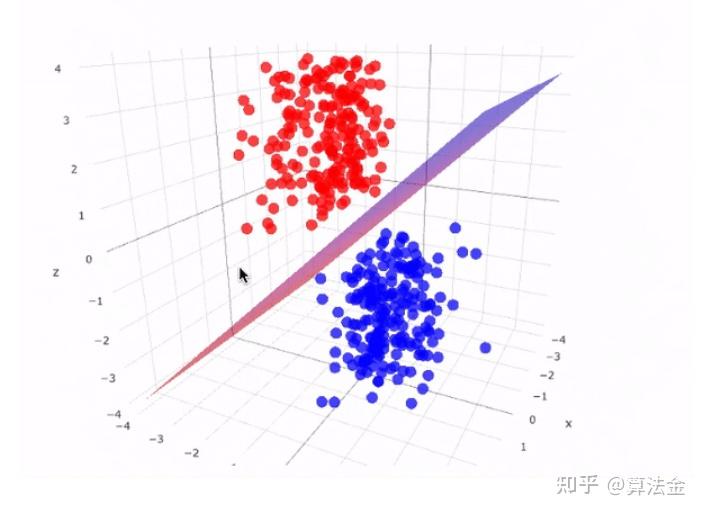

「 6 支持向量机 (SVM)」:寻找最优边界的高效分类器

6.1 概念:寻找最优边界的分类器

6.2 核心原理:最大间隔

6.3 核函数的选择

6.4 应用场景

6.5 优缺点分析

支持向量机(SVM)以其出色的分类性能和强大的理论基础,在机器学习领域广受欢迎。

适当的参数和核函数选择是应用SVM时的关键,通过细致的调整,SVM可以在各种应用场景下发挥其强大的能力。

「 7 K-means算法」:聚类分析中的简单而强大的工具

7.1 概念:聚类分析的简单强大工具

7.2. 核心原理:中心点更新

7.3 确定K值

7.4 应用场景

7.5 优缺点分析

K-means算法以其简洁性和效率在聚类分析中占有重要地位,适合于快速初步的聚类分析。

尽管存在一定的局限性,通过适当的预处理和参数调整,K-means仍然是解决聚类问题的有力工具

「8 PCA主成分分析」:数据降维与特征提取的强大工具

8.1 概念:数据降维的数学方法

8.2 核心原理:方差最大化

数据标准化:使得每个特征的平均值为0,方差为1。计算协方差矩阵:反映变量之间的相关性。计算协方差矩阵的特征值和特征向量:特征向量决定了PCA的方向,特征值决定了方向的重要性。选择主成分:根据特征值的大小,选择最重要的几个特征向量,构成新的特征空间。

8.3 应用领域

8.4 优缺点分析

PCA主成分分析作为一种强大的数据降维工具,在多个领域都有广泛应用。

它不仅可以帮助研究者和分析师简化数据,还能揭示数据背后的隐藏结构和模式,是数据预处理和探索性数据分析中不可或缺的技术之一。

「 9 集成学习 」:合力战胜单打独斗的机器学习策略

9.1 概念:合力战胜单打独斗

9.2 核心算法:随机森林、

9.3 集成策略: 与

9.4 应用场景

9.5 优缺点分析

集成学习通过组合多个模型来提高预测的准确性和稳定性,是提升机器学习项目性能的有效手段。

虽然它带来了更高的计算成本和更复杂的模型调优过程,但在处理复杂的机器学习问题时,其优势通常远大于这些缺点

「 10 神 经 网 络」:“模仿”人脑的算法结构

10.1 概念:模仿人脑的算法结构

10.2 核心原理:前向传播与反向传播

10.3 应用场景

10.4 优缺点分析

神经网络作为深度学习的基石,在各个领域内展现出了巨大的潜力和价值。

尽管存在一些挑战,如训练成本高和模型解释性差等,但通过不断的研究和技术进步,这些问题正逐步被解决。

神经网络将继续在AI领域扮演重要角色,推动科技发展。

「 抱个拳,总个结 」

在人工智能的浩瀚江湖中,上述算法不仅是构建复杂模型的基石,更是通往智能化世界的关键。

它们像是武林中的基本武功,虽然单一的技能可能看似简单,但正是这些基础技能,铸就了人工智能领域的辉煌。

正如武侠世界中,没有坚实的基本功,便难以达到登峰造极的境界;在人工智能的世界里,深入理解这些算法,对于任何志在于此领域中留名的探索者来说,都是必不可少的修炼。

只有掌握了这些基本的算法,才能在人工智能的道路上走得更远,探索更深。让我们以这些基础算法为剑,开启智能技术的大门,探寻未知的世界。

「 算法金,碎碎念 」

日更快满百日了,今天开始进入算法内容

就今天这最基础的内容,光排版就花了半小时

忍不住要一下,我这日更万日真是太难了…

全网同名,日更万日,让更多人享受智能乐趣,今日 98/10000

烦请大侠多多点赞、比心、收藏,助力算法金又猛又持久、很黄很 BL 的日更下去;我们一起,让更多人享受智能乐趣

同时邀请大侠 关注 算法金,围观日更万日,助你功力大涨,笑傲江湖

打完收工 [抱拳礼],有缘再会